写真測量法(フォトグラメトリー)を用いた3Dスキャン スタジオ『iris』について

レスパスビジョン株式会社は多数の一眼レフカメラから写真測量法(フォトグラメトリー)を用いて高品質な3Dモデルデータを生成する3D スキャンスタジオ『iris』を2017年6月より弊社地下2階のスタジオにオープンしました。おかげさまで好評稼働中です。

2021年7月に一時的に東宝スタジオ内に移設しています

開発・運用は弊社のクリエイティブチーム"steam studio"が担当しました。スタジオにはモデラー兼VFXジェネラリスト3名が常駐しており作品によって最適なアプローチを提案可能な体勢になっています。

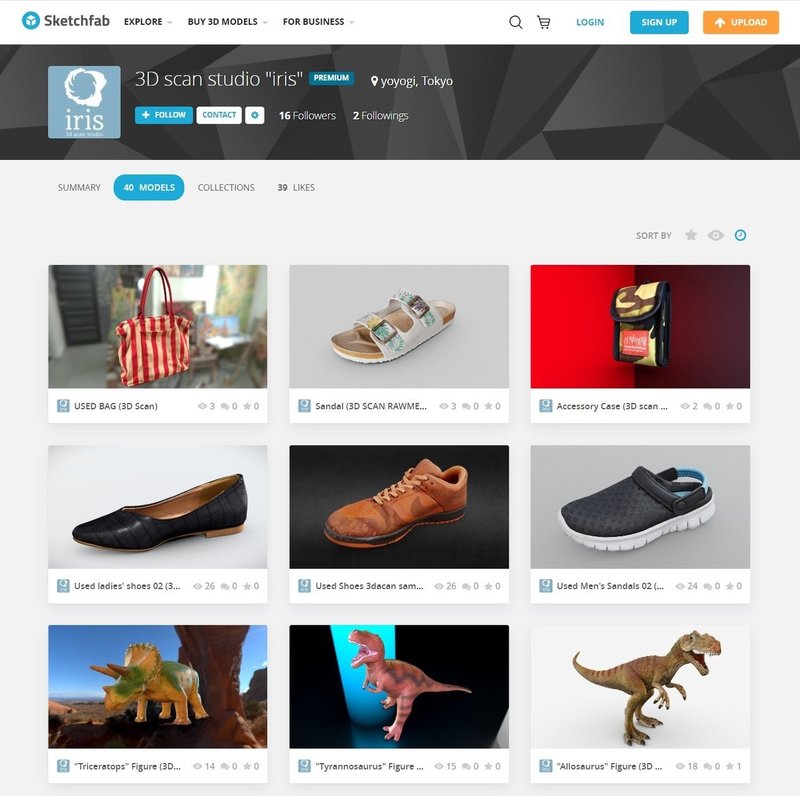

・3Dスキャンサンプルはこちら

https://sketchfab.com/ss-iris/models

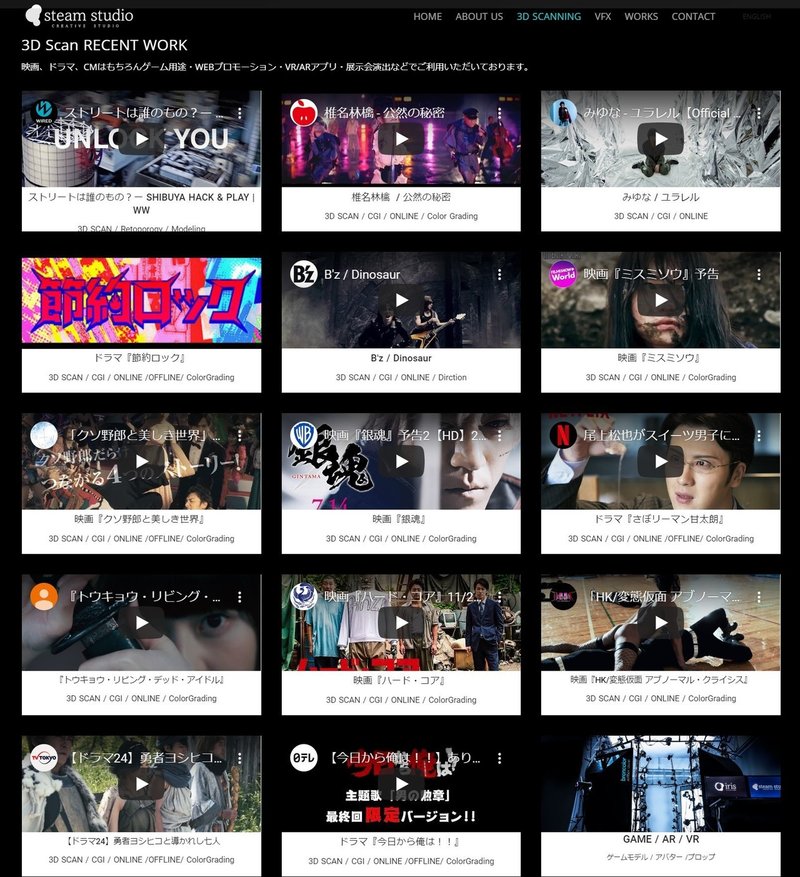

3Dスキャン実績

映画 『シン・仮面ライダー』

SILENT HILL f ティザートレーラー

映画『ブラックナイトパレード』

Amazonプライムビデオ『仮面ライダーBLACK SUN』

映画『キングダム2 遥かなる大地へ』

『全裸監督 シーズン2』 - Netflix

NHK 大河ドラマ「青天を衝け」

NHK 大河ドラマ「青天を衝け」

映画『GHOSTBOOK おばけずかん』

舞台『ハリー・ポッターと呪いの子』

米津玄師「POP SONG」

UA - お茶

PS4 AAAタイトル用のアセット制作

NIKE Air Zoom Type “MACCIU BY YOU”

柴犬まる

マンナンライフ ララクラッシュ 親子篇

椎名林檎 MV / 公然の秘密

B'z MV / Dinosaur

Amazon Prime Video『誰かが、見ている』

ドラマ『今日から俺は!!』

ドラマ『節約ロック』

ドラマ『さぼリーマン甘太朗』

映画『ミスミソウ』

映画『HK/変態仮面 アブノーマル・クライシス』

テレビ東京【ドラマ24】「勇者ヨシヒコと導かれし七人」

映画 『アーヤと魔女』

映画『銀魂』

映画『クソ野郎と美しき世界』

その他VR、AR向けアセット制作

作品実績は以下のページをご参照ください。

フォトグラメトリーとは

【フォトグラメトリー】は大量の画像から「3Dモデル」と「3Dモデル用のテクスチャ」を得る事ができる非接触な3D測量手法の1つです。

大量の画像の中の「共通の特徴点」を検知し、その特徴点の視差から3D座標を計算し、「点群」を算出します。その点群を「面」に変換し3Dモデルと3Dテクスチャを生成します。

Google Earth/GoogleMapの3D航空写真,3Dの建造物の一部はこの手法で膨大な航空写真から作り出されています。

比較的低コストからシステム構築可能な写真測量法(フォトグラメトリー)はレーザー測定器(FAROなど)による3Dモデル作成と並び製造・建築・土木の業界でも定番となっています。

またレーザー測定器を用いた手法では高精細な画像は得られず基本的には頂点座標と頂点カラーのみのポイントクラウドデータしか得られないため、精度の高い画像を得られるフォトグラメトリーと併用したり、組み合わせることも可能となっています。

近年では「NeRF」(Neural Radiance Fields)によるAI学習による3Dスキャンも徐々に実用化されつつあります。

フォトグラメトリーのメリット

従来リアルな3Dモデルは資料画像を撮影しモデリング担当者が手作業で経験に基づき作業していました。

正面図・側面図だけの画像からでは本物と瓜二つに造形することはかなりの難易度になります。(勢いでなんとなく似せるモデリングは比較的容易です)

フォトグラメトリーでは人間のように物体の「陰影」から立体感を推測するのでは無く、見た目にとらわれない測量技術をベースにしています。そのため正確かつ微妙な凹凸を再現可能です。

タイトなスケジュールの中で多くのVFXこなさなければならない場合、CGIアセット制作だけに多くの時間をさけるわけではありません。

フォトグラメトリーにより造形の基礎となる正確な3D形状を半自動で得られるだけでも作業効率は大きく向上します。

また作業担当者の熟練度が「中」程度でもワークフローを構築すれば問題なく高品質な3Dモデルを作成することが出来ます。

実際に弊社の2年目のキャリアのモデラーが多くの作業をこなしました。少数でVFX制作を行っている弊社のCG部でこの高い精度・生産性はとても助かっています。

NeRFとフォトグラメトリーの比較

近年では「NeRF」(Neural Radiance Fields)によるAI学習による3Dスキャンも徐々に実用化されつつあります。

我々も万能かと思ったNeRFですが、実際に試してみると高品質3Dアセット作成業務で積極利用するのはまだ難しそうです。

以下雑感になります。

「NeRF」の3Dアセット制作上のデメリット

・NeRF専用のRadiance Fieldsをレンダリング可能な専用3Dビューワーで結果(neural renderer)を確認しないと臨場感を全く感じない

・通常の3Dメッシュに変換すると書き出すとフォトグラメトリースキャン以下の品質の場合が多い。

・テクスチャ、メッシュ形状の細部が曖昧になり崩れる

・繊細なディティールは再現しにくい

・反射材質には強いが形状が正確に得られるわけではない。

・GPUメモリの制限で高解像度なDiffuseテクスチャが得られない

・単純なメッシュ精度比較ではiPhone+LiDARでの3Dスキャンのほうが高品質の場合も多い

・cross-polarizationで撮影した画像では反射が少ないためNeRF学習プロセスでエラーが起きる

・クラウド型のNeRFサービスはアップロードした画像、動画をAIの学習、他のサービスに転用されます。秘匿性の高いプロジェクトでは各サービスのTerms of Service / Privacyの内容をよく確認することが必要です。

これまでの3Dアセット制作の延長上としてはNeRF活用は難しいですが、

NeRFの強みをそのまま活かすのが現状ベストかと思われます。

「NeRF」のメリット

・Radiance Fields専用3Dビューワー(Neural renderer)で閲覧した時の圧倒的な臨場感 (多視点アングルでも現実の光の反射を再現できる)

・汎用的な対象物・空間の場合、少ない写真でもざっくりとした形状を破綻少なめで再現できる

・反射が強い被写体でもメッシュに穴が空きにくい!

・アルゴリズム、対応アプリにもよるが、空などの最遠景もキャプチャ可能

・テクスチャ、形状を曖昧に捉え、専用ビューワー上(Neural renderer)

で再現することができる (フォトグラメトリでは曖昧部分に破綻が起きる)

・Neural rendererにより物体の反射そのものを再現することができる

・単純にNeural rendererのもやもやした見た目がエフェクトとしてかっこいい!

・広い空間をリアルに再現する手法として向いている

・小さなアセットの場合、キラキラとした材質部分があるとリアルに再現できる

・今後VR上でNeural renderできるReal-time NeRFが発展したらもの凄い臨場感が期待できる

輝度場であるRadiance Fieldsそのものを多視点からレンダリング・閲覧できる専用ビューワーとセットで「NeRF」の凄さが感じられていると思います。

ありのままを描画する点では【もの凄いUnlitシェーダー】と考えられます。

MAYA、Houdini、BlenderなどでRadiance Fieldsそのものを気軽にレンダリング(Neural render)できるようになれば様々な表現手法の一つとして標準的になるのではないでしょうか。

曖昧な場の雰囲気をキャプチャ・再現可能なため、3Dアセット制作での活用よりもRadiance Fieldsのレンダリング結果をそのまま映像表現として活用するのが現状ではベストかと思われます。

フォトグラメトリ+LiDAR+NeRFを手軽に組み合わせ、いいとこ取りできるソリューションやアプリの登場が待たれます。

スキャンデータの活用

デジタルダブル(CGスタント)

VFXを多用する映画・ドラマにおいてスタントマンの担当範囲を超える演出の場合は演者をCGに置き換えることになります。

全身だけではなく、複雑な3Dエフェクトを施すために手や顔などの各部位の置き換えなども多くあります。実写素材・CG・演者とが絡む複雑なシーンなども超フォトリアルな3Dモデルを活用することによってグリーンバック撮影やCG作業、ポストプロダクション作業全行程で劇的に作業効率が上がります。

特に人物はほぼ動かないがカメラがダイナミックに動く合成シーンの場合は人物を3Dスキャンしてしまえばグリーンバック撮影、モーションコントロール撮影が不要になる可能性があります。

地形・空間・小物等のリアルな造形の再現(CGIアセット)

自由なカメラワークを演出するためには演者だけではなくセット美術、小物全てをCGで置き換えるフルCG(CGI)でシーンを構築しなければなりません。

膨大な数の物体を正確に手作業でモデリングすることは制作期間と作業人数を鑑みてしばしば見送られてきました。フォトグラメトリーを活用することによってフルCGのシーン構築がかなり現実的になりました。

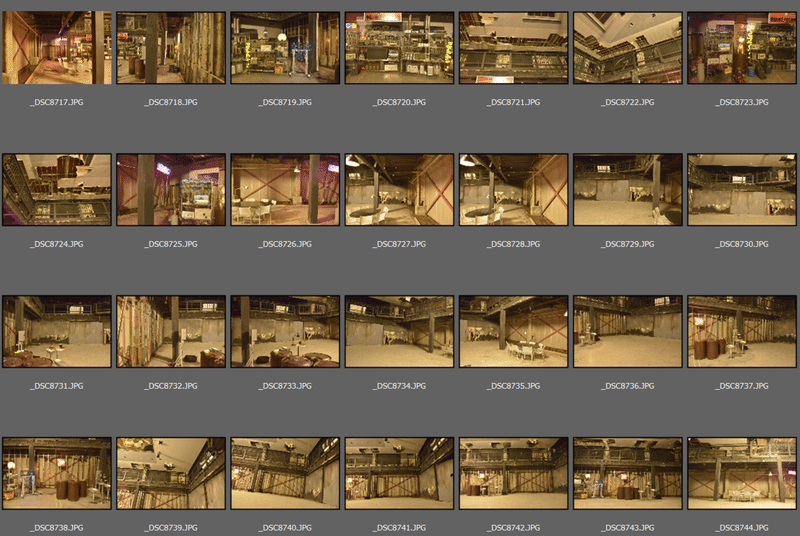

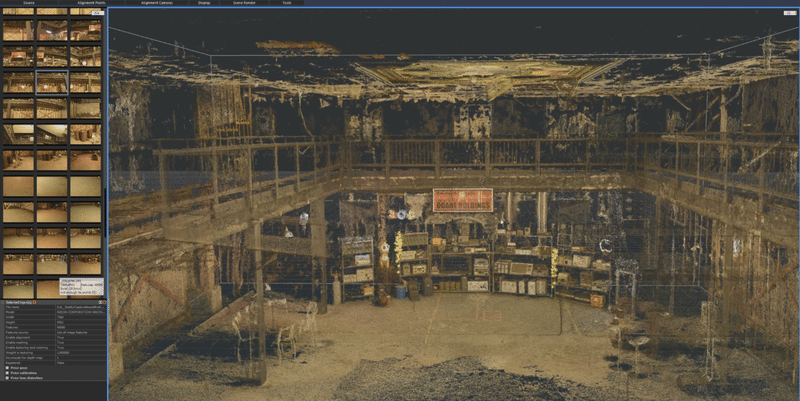

映画『HK/変態仮面 アブノーマル・クライシス』では屋内セットをフォトグラメトリーにより3D化し、主人公・敵キャラクター含めたフルCGのシーンを構築しました。

<約300枚の写真を撮影現場で撮影>

<フォトグラメトリーにより形状の精度は荒いものの、正確な採寸と高品質なテクスチャ画像が得られる>

insta360 Xなどの高画質な360度カメラが普及し、一昔に比べて効率的に環境を3Dスキャンできるようになってきました。

3Dスキャン スタジオ『iris』

セットや建物、固定物に関しては現場収録しか撮影方法はありませんが、人物や小物を精密に3Dスキャンするにはやはり専用のシステムが必要です。

一般的には撮影枚数が多いほど高精度なスキャン結果が得られるため、目的に合わせてスキャンのシステムを使い分けます。

3Dスキャンスタジオ『iris』には以下の3つのシステムを被写体によって使い分けています。

<3Dスキャンスタジオ『iris』 の全身用スキャンシステム>

3Dスキャンスタジオ『iris』にはアプローチの異なるの3つのシステムが存在します。

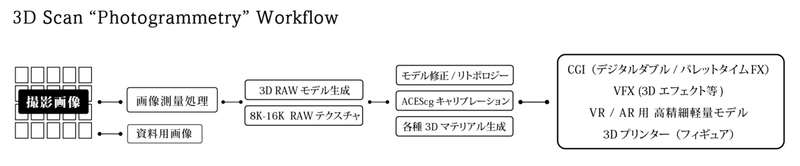

<フォトグラメトリーのワークフロー プロジェクトに応じて柔軟に対応可能です。>

人体用のスキャンシステム

人体は完全に静止することはできず、ターンテーブル等で撮影したものを使用すると形状に著しい破綻が起きます。その為、人体のスキャンでは多数のカメラを同期させ一瞬で撮影することが不可欠です。

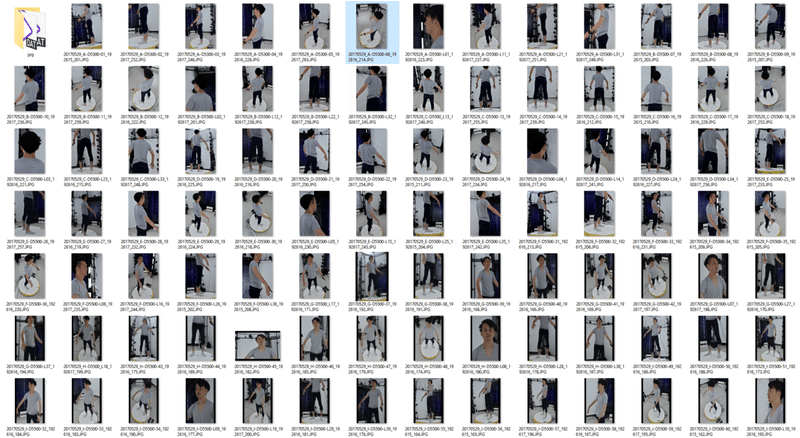

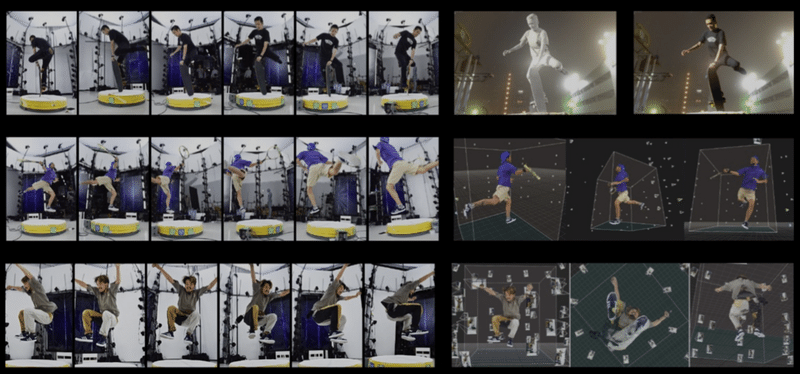

本システムではNikon一眼レフカメラ173台で構成。 全てのカメラのシャッターとストロボを同期させて撮影を行います。閃光速度は最小1/2000秒ですのでジャンプした瞬間など「動き」を捉える「アクションスキャン」にも対応しています。映画マトリックスで有名になったCGIベースの「バレットタイムFX」などに便利です。

ストロボは比較的大光量のまま閃光時間を短くできるbroncolorのストロボSiros800S(800W)を10灯で構築しました。他社製品も検討しましたが閃光時間を短くすると出力も落ちていってしまうことからbroncolorの採用になりました。

収録はバックアップとしてカメラ内臓のSDカードにも収録しますが、基本的にはUSB接続によるテザー収録を行い直接PCへ保存されます。

収録は「JPEG」「RAW」「JPEG + RAW」いずれかで可能です。主に十分な品質を担保できるJPEGを主に使用しています。

全身スキャンのポリゴン精度は約4000万ポリゴン、ジオメトリ精度は約2mm、テクスチャは約1mmの精度。テクスチャのサイズは最大16Kでスキャンすることが可能です。

<現在はカメラ173台で3Dモデルを生成している。 資料撮影としても有効に活用可能>

<映画「マトリックス」で有名になったアクションの一瞬を捉えるエフェクト、バレットタイムFX用のスキャンも可能です>

ジャンプした瞬間でもスキャン可能です。スポーツ系のゲーム用スキャンの実績もあります。

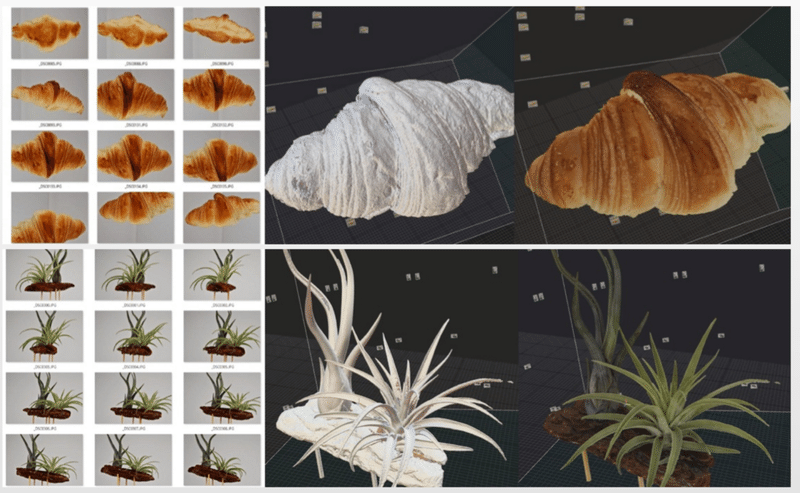

物撮り専用システム

物撮り専用のターンテーブルを用いたシステム。カメラ台数は1台だが被写体を回転させ何枚でも撮影可能。形状にもよりますが200枚-500枚の撮影を行います。Ra95高演色LED16灯+ソフトBOXで定常光で使用。

ストロボの使用も考えましたが膨大な撮影枚数になるため定常光を採用。ストロボの紫外線の問題や作業者の頭痛の原因になるため控えました。

最小では1cm、最大で70cmの幅の物体をスキャンすることが可能です。得られるポリゴンは最大1億ポリゴン。ポリゴン解像度は1mm、テクスチャ解像度は0.3mm。テクスチャは最大16Kで出力可能です。

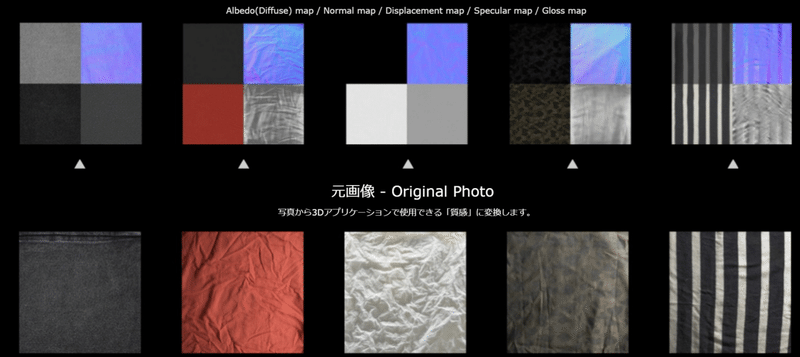

布地スキャンシステム

「Photometric Stereo」という手法で3Dスキャンでは不可能な細かい布地などのディティールをスキャン可能なシステム。0.3mm以下の解像度があります。

凹凸の表現を立体ではなく画像により表現可能です。少ないポリゴンで繊細なテクスチャ表現が可能です。硬貨のレリーフなどの繊細な凹凸をNormal Mapとして得られます。

ハンディスキャン

1cmから4mまでの小物を3Dスキャン可能なハンディースキャナー

ジオメトリ精度約1mm・テクスチャ精度は約0.3mm。最大テクスチャサイズは 2K。ロケ先などでの3Dスキャンが可能です。

カラーマネジメント

フォトグラメトリ処理後のテクスチャ(AdobeRGBカラースペース)は精度の良いカラーマトリクス変換でNUKEでキャリブレーションされ、色域を「ACEScg」で統一することにより様々なシネカメラの色域に合わせて柔軟に対応することも可能になりました。

カラーチャートを用いて18%のグレーがRGBニュートラルかつ適正露出になるように調整しています。

ピクセル値1.0以上を含むOpenEXRで納品することも可能です。

キャリブレーションプロセスを施さなくとも一眼レフ+業務用ストロボの環境光で非常にバランスの良いテクスチャが得られます。

フォトグラメトリーで精度が低下する原因

フォトグラメトリーは画像が全てですから画像が悪ければそのままスキャン精度の低下へとつながります。可能な限り画質低下に対して対応・工夫しています。

・カメラのブレ

画ブレはそのまま品質の低下につながるためこのシステムではストロボの高速閃光により微細な揺れをカバーしています。物撮りの場合はF20付近まで絞り込むので感度をギリギリまであげて対応しています。

・ピントずれ

フォトグラメトリー手法のピントずれは極めて大きな破綻につながります。限界までF18付近まで絞り込んでピントズレのリスクを回避しています。人体の場合は姿勢・体勢が予測不可能な場合も多く173台全てをマニュアルフォーカスで調整しています。

・物体の鏡面反射(ハイライト)

フォトグラメトリーの破綻を大きくさせる要因の一つに物体に生じる「ハイライト」があります。

ハイライトは被写体そのものの色ではなく光源そのものが写り込んだものです。物体色では無いため共通の特徴点にはならず不正な形状の原因になってしまいます。

解決方法としては360度全てを使った壁バウンス光源にし、光源の切れ目をなくす手法。あるいは偏光フィルター2つを使ったcross-polarizationを用います。どちらにもメリット・デメリットがありますが弊社のスタジオでは全てのシステムにcross-polarization手法を採用しました。

ストロボ側とカメラレンズのフィルターどちらにも偏光フィルターを用いるのですが、3STOP以上の光量低下が発生するのがデメリットになります。

この手法で得られる画像はハイライトが無くなり、まるで水中で撮ったようなフラットなルックになります。このハイライト成分を除去した画像は3D CG上で照明を設定するにあたり非常にうまく機能します。

ハイライトを除去しない場合は現実世界と3D CGの2箇所で2重にハイライト成分が発生してしまうからです。フォトリアルなCGI作業においてテクスチャから光源の影響(ハイライトと陰影)を除去することは重要です。

cross-polarization手法を用いることによって大幅にハイライト成分を除去出来ますので効率的で高品質な3Dテクスチャを作り出すことが可能です。

※撮影前の「皮脂おさえ」も重要です!!

膨大な計算コスト

撮影は市販の一眼レフ、最近では高画質化しているスマートフォンでも十分な精度を得られますが、3Dモデルを生成するためには膨大な計算処理が必要であり、業務として短時間で処理させるには高価なワークステーション(高スペックCPU/複数枚のGPU)が必要になります。

弊社の環境の場合、170枚の画像では2時間、500枚では約6時間計算時間が必要になります。

得られる3Dデータは最大で1億ポリゴンにもなります。計算直後の3Dデータはノイズ成分が多くそのままではまず使用できません。その後1000万~2000万ポリゴンにまで減らしZbrushという造形ソフトで3Dモデラーによるレタッチ工程があります。

最終的には2〜15万ポリゴンにまで減らし、繊細な凹凸は凹凸を表現可能な専用の画像(Normal Map/ Displacement Map)を用いて再現します。

後処理の膨大な計算時間と作り出される巨大なポリゴンデータの効率の良い扱い方はまだまだ研究の余地があります。

フォトグラメトリーの課題

予算の都合もありまだまだ足りない部分がありますが都度都度カスタマイズし拡張可能なのもフォトグラメトリーシステムの良いところです。

カメラ台数はさらなる精度確保のため順次増設していきたいところです。(海外のシステムが200台以上で組まれているのは精度を考えると納得です)

モデルがリアルになれば付随して産毛や髪の毛等の体毛の表現、現実味のある皮膚の表現なども共に高い品質が必要になります。この点も研究テーマとして欠かせません。

アニメーションに関しては外部のモーションキャプチャースタジオなどと連携し様々な用途向けにサービス提供可能です。

詳しくは以下のWEBフォームからお問い合わせ下さい。

この記事は「映画テレビ技術」 2017年9月号 向けに寄稿したものを再編集しています。